Intelligent Tunnel Crack Recognition Based on Automatic Sample Labeling

-

摘要:

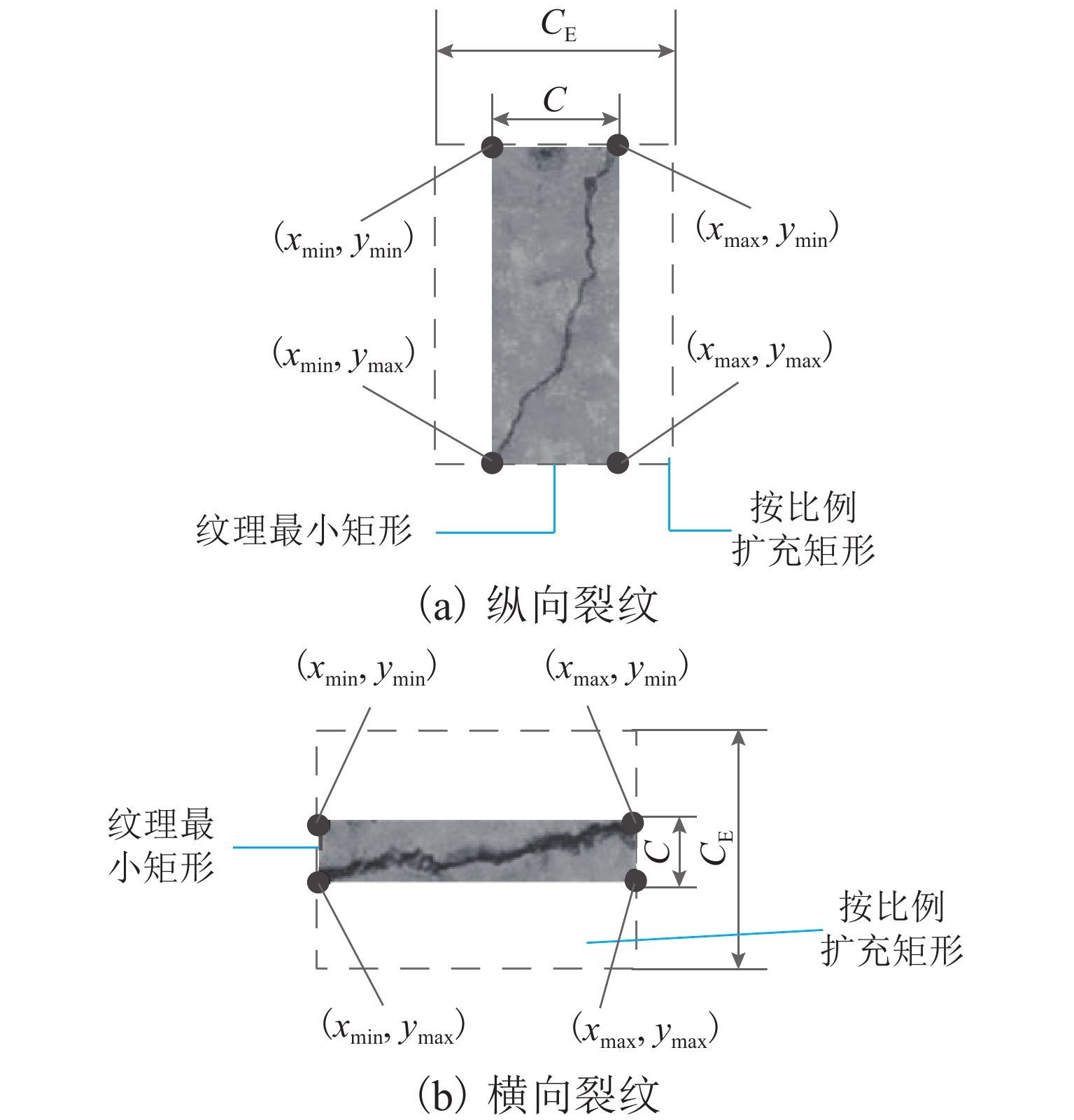

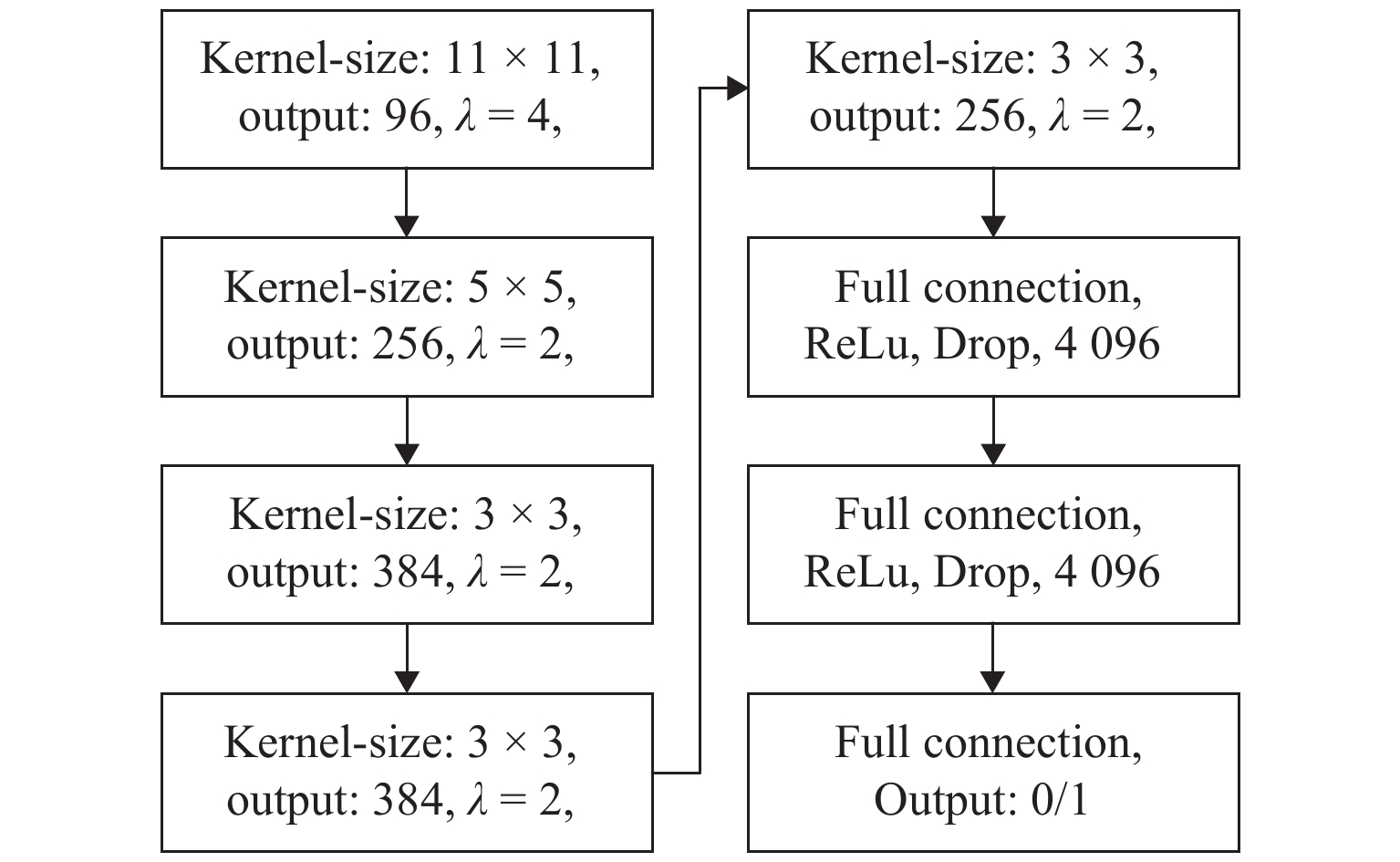

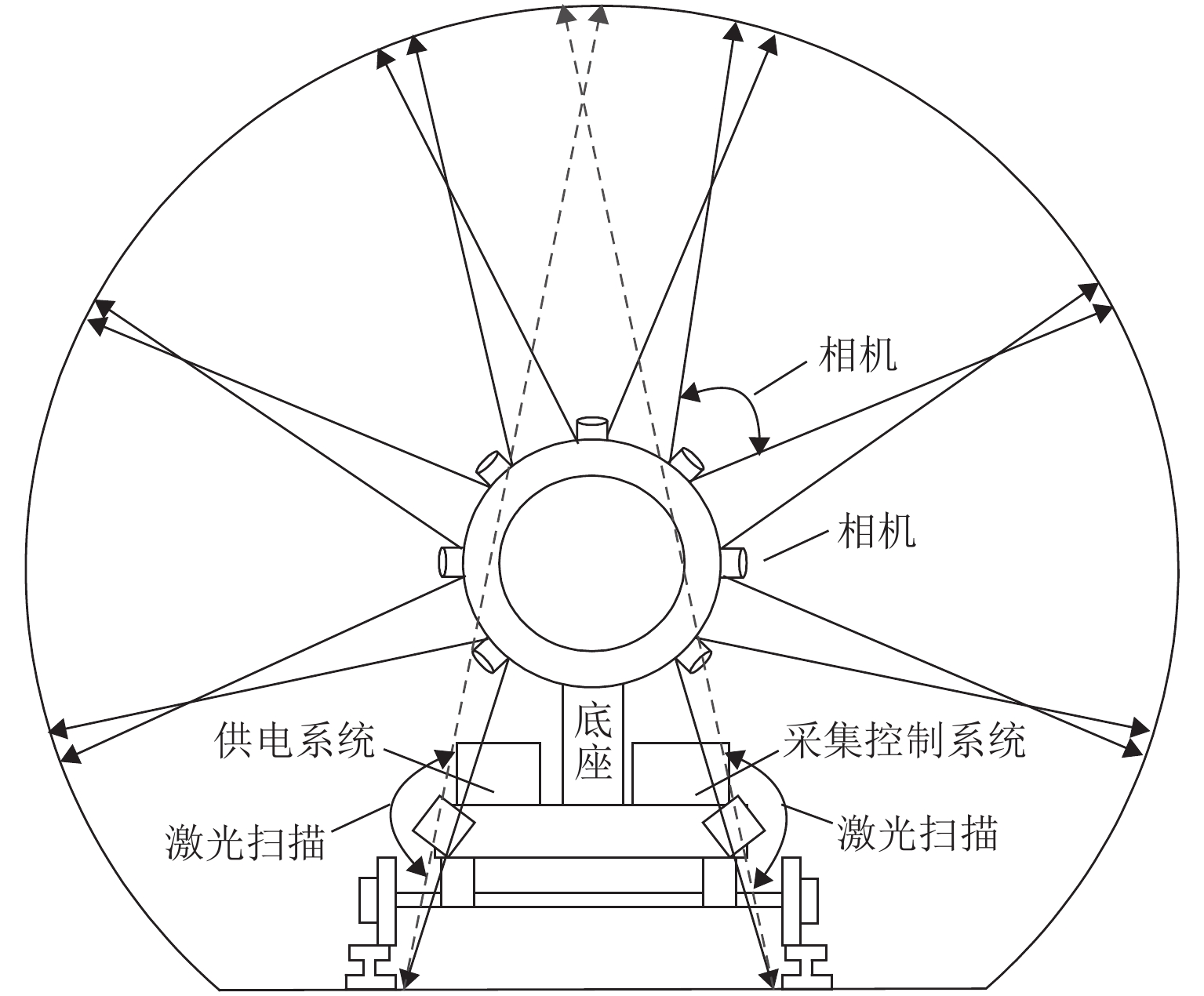

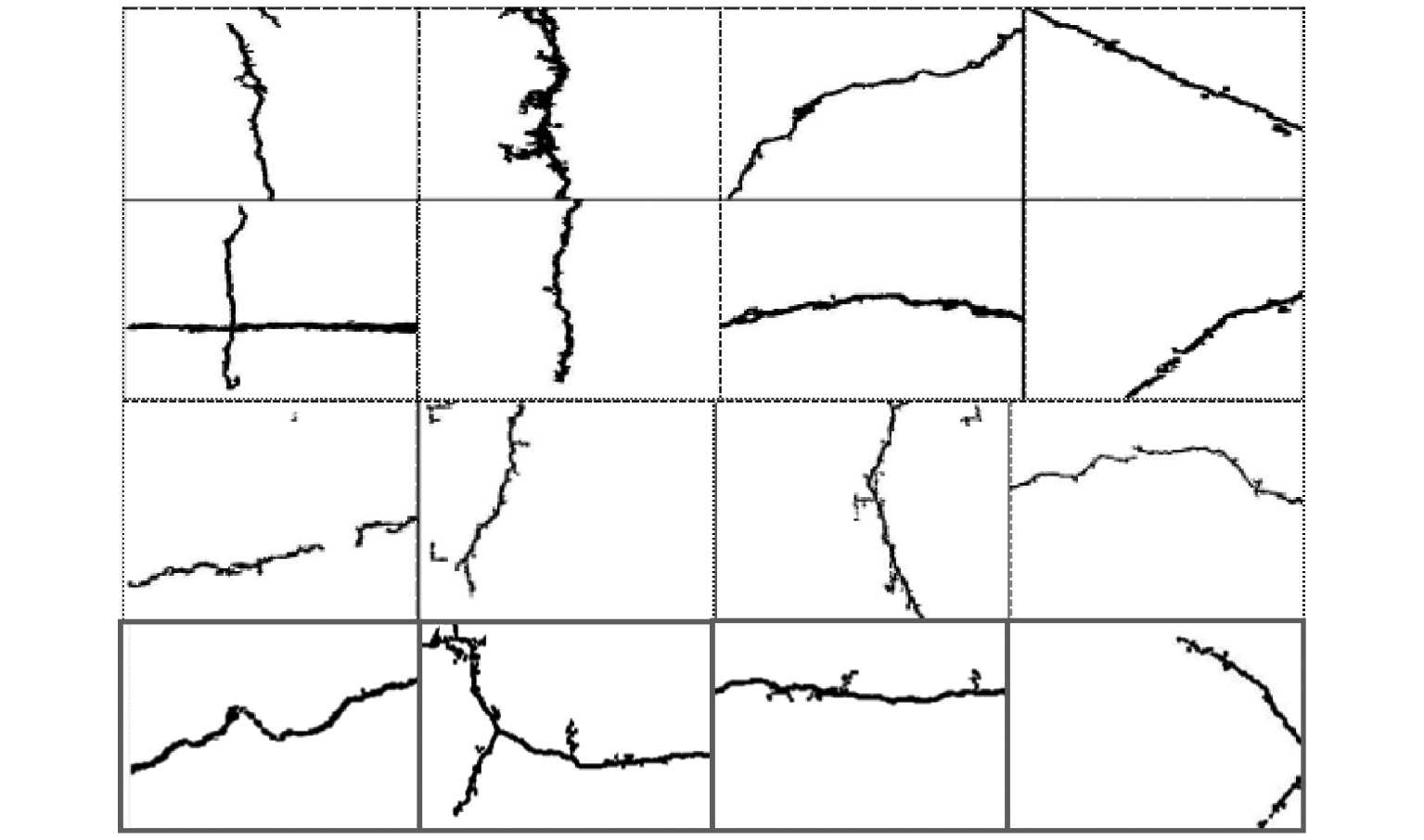

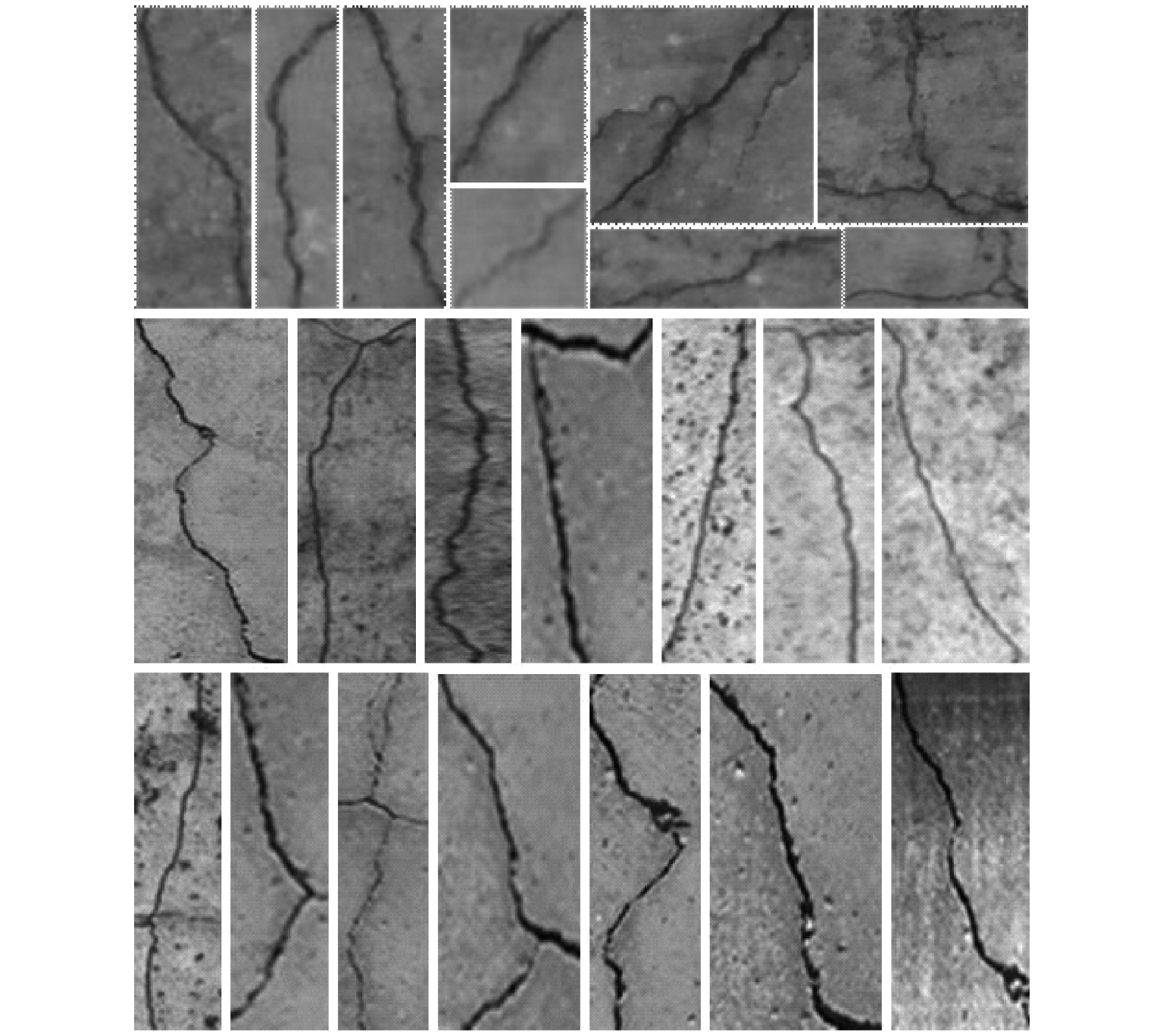

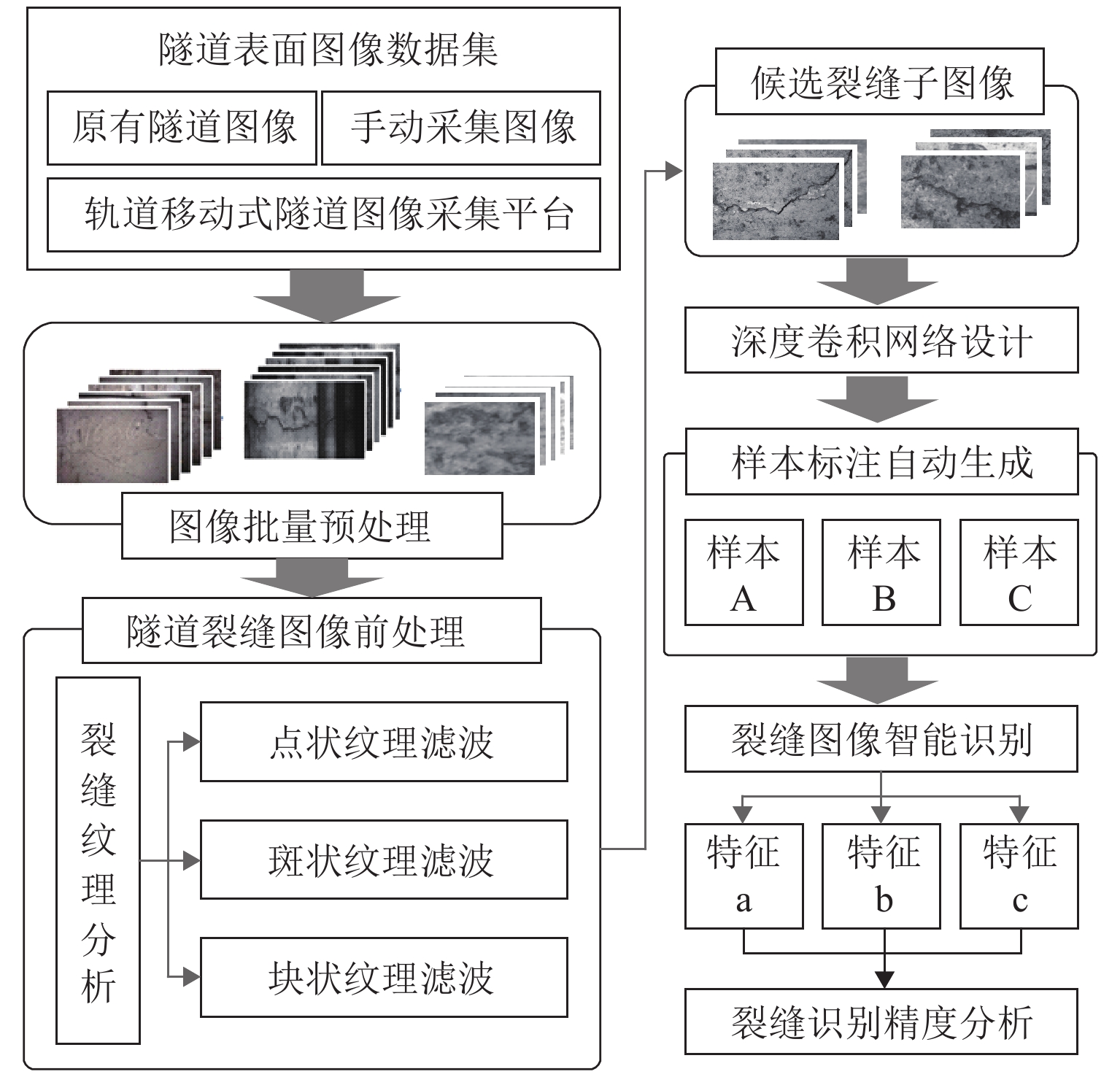

隧道表面裂缝的检测已经成为地铁运营人员的重要巡检任务之一. 为实现隧道裂缝病害的自动监测,提出一种结合病害特征提取和深度学习的隧道裂缝样本自动标注与识别算法;针对隧道裂缝形态特征建立裂缝图像的特征样本库,改进了AlexNet深度卷积网络结构;设计研制了轨道移动式隧道图像采集系统以及巡检车,采集并构建了包含4500张裂缝图像样本和1500张测试图像的数据集,用以验证算法的可行性和有效性. 研究结果表明:采集的图像清晰度符合要求,所设计算法可完成裂缝目标自动标注;裂缝图像测试集的识别率达到97.8%,证明了算法研究和采集系统的有效性.

Abstract:Detecting tunnel surface cracks has been one of the important tasks for subway operators. To achieve the automatic detection of tunnel cracks, this paper proposed an automatic labeling and recognition algorithm for tunnel crack samples, which combined crack feature extraction with deep learning. The paper also established an image feature library of crack samples based on the feature of tunnel cracks and improved the structure of the deep convolution network, namely AlexNet. In addition, the paper designed a track-sliding tunnel image acquisition system and inspection vehicle and then established a dataset consisting of 4 500 crack image samples and 1 500 test images, so as to verify the feasibility and effectiveness of the algorithm. The result shows that the clarity of the collected images meets the requirements, and the designed algorithm can complete the automatic labeling of cracks. The recognition rate of the crack image dataset is 97.8%, which can verify the effectiveness of the algorithm and the acquisition system.

-

Key words:

- image acquisition /

- image processing /

- cracks /

- deep learning /

- sample labeling

-

表 1 采集装置参数信息表

Table 1. Parameters of acquisition device

名称 参数 相机自身旋转角度/(º) 0~360 相机可平移距离/cm 0~15 光源可平移距离/cm 0~15 光源自身旋转角度(º) 0~360 采集装置平移距离/cm ±30 采集装置上下调节距离/cm 80~120 表 2 裂缝图像样本数据分类识别准确率

Table 2. Recognition accuracy of crack image sample data

% 样本 本算法训练准确率 本算法测试准确率 SVM 训练准确率 SVM 测试准确率 原始图像样本 88.0 89.1 75.8 70.3 二值图像样本 80.7 80.4 80.6 74.5 裂缝外接矩形样本 95.4 94.0 88.5 84.9 裂缝区域扩充样本 98.6 97.8 89.0 87.8 -

[1] 罗佳,刘大刚. 基于自适应阈值和连通域的隧道裂缝提取[J]. 西南交通大学学报,2018,53(6): 1137-1141,1149. doi: 10.3969/j.issn.0258-2724.2018.06.007LUO Jia, LIU Dagang. Tunnel crack extraction based on adaptive threshold and connected domain[J]. Journal of Southwest Jiaotong University, 2018, 53(6): 1137-1141,1149. doi: 10.3969/j.issn.0258-2724.2018.06.007 [2] GAO X W, LI S Q, JIN B Y, et al. Intelligent crack damage detection system in shield tunnel using combination of retinanet and optimal adaptive selection[J]. Journal of Intelligent & Fuzzy Systems, 2021, 40(3): 4453-4469. [3] REN Y P, HUANG J S, HONG Z Y, et al. Image-based concrete crack detection in tunnels using deep fully convolutional networks[J]. Construction and Building Materials, 2020, 234: 1-12. [4] 王睿,漆泰岳. 基于机器视觉检测的裂缝特征研究[J]. 土木工程学报,2016,49(7): 123-128. doi: 10.15951/j.tmgcxb.2016.07.012WANG Rui, QI Taiyue. Study on crack characteristics based on machine vision detection[J]. China Civil Engineering Journal, 2016, 49(7): 123-128. doi: 10.15951/j.tmgcxb.2016.07.012 [5] 朱力强,王春薇,王耀东,等. 基于特征点集距离描述的裂缝图像匹配算法研究[J]. 仪器仪表学报,2016,37(12): 2851-2858. doi: 10.19650/j.cnki.cjsi.2016.12.027ZHU Liqiang, WANG Chunwei, WANG Yaodong, et al. Algorithm of crack images matching by feature points set distance description[J]. Chinese Journal of Scientific Instrument, 2016, 37(12): 2851-2858. doi: 10.19650/j.cnki.cjsi.2016.12.027 [6] MEDINA R, LLAMAS J, GÓMEZ-GARCÍA-BERMEJO J, et al. Crack detection in concrete tunnels using a Gabor filter invariant to rotation[J]. Sensors, 2017, 17(7): 1-16. [7] HUANG H W, LI Q T, ZHANG D M. Deep learning based image recognition for crack and leakage defects of metro shield tunnel[J]. Tunnelling and Underground Space Technology, 2018, 77: 166-176. doi: 10.1016/j.tust.2018.04.002 [8] ATTARD L, DEBONO C J, VALENTINO G, et al. Tunnel inspection using photogrammetric techniques and image processing: a review[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2018, 144: 180-188. doi: 10.1016/j.isprsjprs.2018.07.010 [9] PROTOPAPADAKIS E, VOULODIMOS A, DOULAMIS A, et al. Automatic crack detection for tunnel inspection using deep learning and heuristic image post-processing[J]. Applied Intelligence, 2019, 49(7): 2793-2806. doi: 10.1007/s10489-018-01396-y [10] CHA Y J, CHOI W, BÜYÜKÖZTÜRK O. Deep learning-based crack damage detection using convolutional neural networks[J]. Computer-Aided Civil and Infrastructure Engineering, 2017, 32(5): 361-378. doi: 10.1111/mice.12263 [11] DORAFSHAN S, THOMAS R J, MAGUIRE M. Comparison of deep convolutional neural networks and edge detectors for image-based crack detection in concrete[J]. Construction and Building Materials, 2018, 186: 1031-1045. doi: 10.1016/j.conbuildmat.2018.08.011 [12] LIU Z Q, CAO Y W, WANG Y Z, et al. Computer vision-based concrete crack detection using U-net fully convolutional networks[J]. Automation in Construction, 2019, 104: 129-139. doi: 10.1016/j.autcon.2019.04.005 -

下载:

下载: